急速に進化する科学技術は、私たちの生活や社会、ビジネスの在り方に大きな変化をもたらしている。その一方で、最先端技術に関する倫理的・法的・社会的な課題――「ELSI(エルシー)」が浮かび上がっている。技術が生み出す新たな可能性と向き合い、どのような未来を築いていくべきか。その答えを見つけるために、今こそ立ち止まり、考える必要がある。

本連載では、話題の新技術やビジネス動向を通じてELSIの考え方をひも解き、社会とビジネスにおける実践的な視点を提供する。今月はリスク学や政策評価を専門とし、大阪大学 社会技術共創研究センター(通称 ELSIセンター)のセンター長を務める岸本充生氏が、「なぜ今ELSIが必要なのか」を解説する。(第4回/全4回)

大阪大学D3センター教授。社会技術共創研究センター(ELSIセンター)長を兼任。産業技術総合研究所安全科学研究部門、東京大学公共政策大学院を経て現職。専門はリスク学、政策評価、先端科学技術のELSI。ELSIセンターでは人文・社会系の産学連携を推進。共著に『基準値のからくり』(講談社, 2014)、共編著『リスク学事典』(丸善出版, 2019)など。地元では小学校のPTA会長を経て中学校のPTA会長、自治会長4年目。 >>プロフィール詳細

どうやって線引きするのか:倫理(E)の出番

それでは「技術的にできてしまうこと」と「社会的にやってよいこと」はどうやって線引きすればよいのだろうか。

これまでの民間企業の活動は、法務によるチェック、具体的には裁判所による過去の判例の確認と、広報やマーケティング部門による世論動向の見極めに基づいていたのではないだろうか。つまり、主に、法(L)と社会(S)を参照していたのである。

ところが、技術革新のスピードが増し、法規制は後追いにならざるを得ないし、そもそも判例も増えない。判例ができたとしてもそのころには技術そのものが変化しているために参考にならない可能性が高い。

また、世論の動向も、SNSにおいて観察されるようにますます不安定で頼りにならない。どの案件が「炎上」するか予測がつきにくくなっている。

こうした中でも、組織として意思決定を行っていくためには依って立つ何かが必要である。不確かな時代には羅針盤が必要なのである。このような羅針盤として、倫理(E)への注目が集まっている。実際、多くの企業や機関でAI倫理原則やAI倫理指針が策定されている。

「適正」か否かの判断が求められるように

日本の個人情報保護法はもともと、個人情報か否か、要配慮個人情報か否かが分かれば、対応が一意に決まるような「形式的ルール」であり、遵守することは比較的たやすかった。しかしパーソナルデータ利活用が複雑化していくと、そのような単純な対応では不十分であることが明らかになってきた。

そのため2020年改正では「不適正な利用の禁止」の項目として、「第十九条 個人情報取扱事業者は、違法又は不当な行為を助長し、又は誘発するおそれがある方法により個人情報を利用してはならない。」が追加された。「違法」に加えて「不当」が追加された。そのデータ利活用について「違法」かだけでなく「不適正(不当)」か否かを事業者が判断しなくてはならなくなったのである。

これは法律が「実体的ルール」化しているといえる。不法行為法などの実体的ルールは通常ならば判例の積み重ねにより相場ができていくことが期待されるのであるが、先に記したように、AIなどの新しい技術は判例ができるころには技術そのものが変化しており、判例が出たとしても、積み重なることは期待できない。事業者自らが倫理原則に立ち返ってそのデータ利活用が適正か否かを判断せざるを得ないのである。

AI倫理原則を活用する

最近閣議決定されたAI法案(「AI関連技術の研究開発・活用推進法案」)においても、例えば基本理念が示された第3条の第4項では「人工知能関連技術の研究開発及び活用は、不正な目的又は不適切な方法で行われた場合には、・・・、その適正な実施を図るため、人工知能関連技術の研究開発及び活用の過程の透明性の確保その他の必要な施策が講じられなければならない。」と書かれ、ここでもまた事業者が「不適切」か「適正」かを判断しなくてはならない構図がある。

実際、多くのテック系企業においてAI倫理原則やAI倫理指針が策定されている。しかし、策定すること自体が目的化してしまい、策定することで満足してしまってないだろうか。

先に述べたように、パーソナルデータ利活用やAIの実装において、その是非を判断するための羅針盤として利用することにこそ「倫理」の価値があるのである。

しかし、倫理と言っても、高名な倫理学者が出てきて、これはOK、あれはダメという教えを乞うことは意味がない。なぜなら法解釈と違って、誰が見ても客観的な正解というものは存在しないケースが多いからである。

出てくる結論の正当性を担保するためには、その結論に至ったプロセスが妥当なものであるかが重要になってくる。原則や指針を作るのはその第一歩にすぎない(もちろん原則や指針を作るためのプロセスも大事である。社訓やパーパス、ミッションなどを参考に、社内の多様な人間が関わり、第三者の意見も取り入れるなどの工夫が必要である。逆に例えば、外注するなどはもってのほかである)。

AI倫理原則に基づいて社内意思決定を改善するやり方は様々だが、 研究開始前から実装後までの研究開発のライフサイクル全体を視野に入れて、要所でチェックできる体制を確立することが重要である。そのうえで技術やサービスのリスクの大きさに応じたプロセスを適用する必要がある。

基本は、原則や指針をそれぞれブレイクダウンして、チェックリスト化する方法である。そのうえで、社内の審査プロセスにおいてチェックリストを活用する。ただし、チェックリストには、リスト以外のことを考えなくさせる落とし穴があるので、抜け漏れがないかを必ず検討する必要がある。

個人情報等を扱う際に行うこうした作業は、プライバシー影響評価(PIA)とも呼ばれ、社内に制度化している企業も多い。

さらに一歩進んだリスクアセスメント

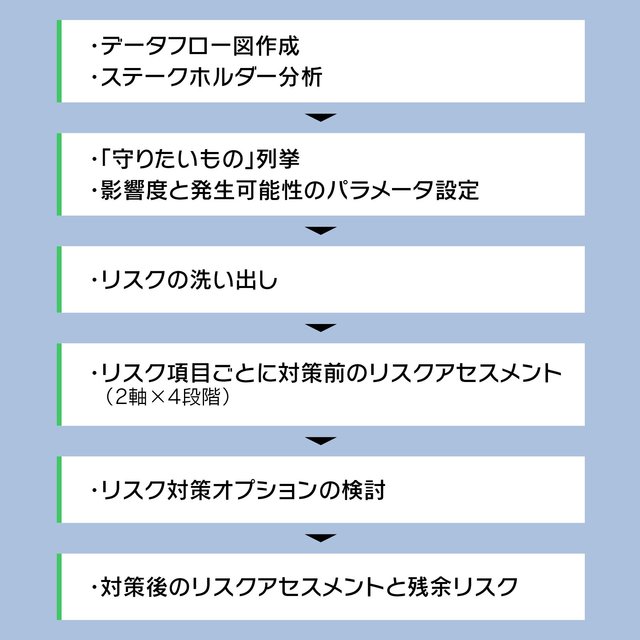

リスクが高いと考えられるユースケースの場合には、ゼロかイチで判断するチェックリストからもう一歩先に進んで、ゼロとイチの間のグレー部分の解像度を上げるためのリスクアセスメント手法を導入する必要がある。理想的には図1のようなプロセスをたどることになる。

死傷や疾病を対象とした化学物質や工学的なリスクアセスメントと異なり、パーソナルデータ利活用の場合は「守りたいもの」を明示する必要がある。人権・プライバシーだったり、人としての尊厳だったり、多様である。

一番の肝はリスクの洗い出しである。既存のケースの知識だけでなく、想像力が必要とされるので、1人でなく、多様なバックグラウンドを持つ複数の人たちによるワークショップ形式で実施することがお勧めである。

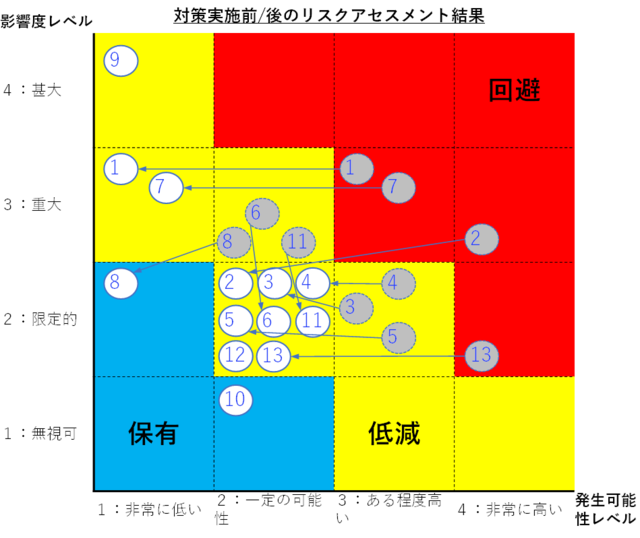

洗い出されたリスク項目をいくつかに集約して、それぞれの影響の大きさと発生可能性を4段階ずつで評価する。この結果は図2のようなリスクマップに並べるとわかりやすい。

このケースでは洗い出された13個のリスク項目のうち、対策前には4項目が赤の「回避」エリアに配置されたため、対策を実施する必要があり、対策の結果、「低減」エリアまで下がったことで、許容できないリスクはないと結論された。

このように、技術・製品・サービスについて、社会実装前に自らリスクアセスメントを実施し、許容できないリスクがないことを自ら示すことで、不適切なデータ利活用がないこと、すなわち適正なデータ利活用であることを、社会に対してだけでなく、社内に対してもアピールすることができる。[註1]

[註1]岸本充生「パーソナルデータ利活⽤のためのリスクマネジメント(1) : プライバシー影響評価(PIA)の制度化」ELSI NOTE No.39. 1-26, 2024. https://doi.org/10.18910/94924

岸本充生ら「大阪大学における全学DX推進施策のリスクアセスメント:顔認証入場システムのケース」ELSI NOTE No.43. 1-21, 2024. https://doi.org/10.18910/95837

【次回更新は2025年5月予定】

ご購入いただくと過去記事含むすべてのコンテンツがご覧になれます。

過去のコンテンツも全て閲覧可能な月額サブスクリプションサービスです。

🔰シンクロナスの楽しみ方

最先端テクノロジーの社会実装における、倫理的・法的・社会的課題=ELSI(エルシー)の最新話題を各分野の専門家が解説。

| 無料の記事を読む |

| AIが日々のストレスを記録!?「感情認識技術」のメリットと課題 |

会員登録がまだの方は会員登録後に商品をご購入ください。